QF-Test stand schon immer für zuverlässige und wartbare Testautomatisierung für Web-, Desktop-, Java-basierte und mobile Anwendungen. Mit der neuen KI-Integration in QF-Test 10 können Sie Ihre Tests mit KI-gestützten Erkenntnissen erweitern — und das Beste daran ist, dass Sie sich nicht auf Cloud-Dienste verlassen müssen. In diesem Beitrag zeigen wir Ihnen, wie Sie QF-Test mit einem lokal laufenden, kostenlosen KI-Modell über Ollama verbinden, sodass Sie direkt auf Ihrer eigenen Maschine mit KI-gestütztem Testing experimentieren können.

Schritt 1: Ollama einrichten

Um zu beginnen, müssen Sie Ollama auf der Maschine installieren, auf der Ihre Tests ausgeführt werden. Ollama stellt kostenlose, lokal gehostete KI-Modelle bereit, die leistungsfähig genug für die grundlegenderen Teile der KI-Integration von QF-Test sind.

- Laden Sie Ollama von der offiziellen Website herunter und installieren Sie es: https://ollama.com/ (Sie benötigen kein Konto).

-

Starten Sie den Ollama-Server, indem Sie ein Terminal öffnen und Folgendes ausführen:

bash ollama serve -

Laden Sie in einem anderen Terminal ein Modell herunter (in der Regel ein paar Gigabyte groß):

bash ollama pull llama3.2

Standardmäßig stellt Ollama das Modell unter http://localhost:11434 bereit, solange ollama serve läuft. Sie können diesen Endpunkt nun in QF-Test verwenden, um KI-Anfragen zu senden — ganz ohne Internetverbindung.

Schritt 2: QF-Test für die Nutzung der lokalen KI konfigurieren

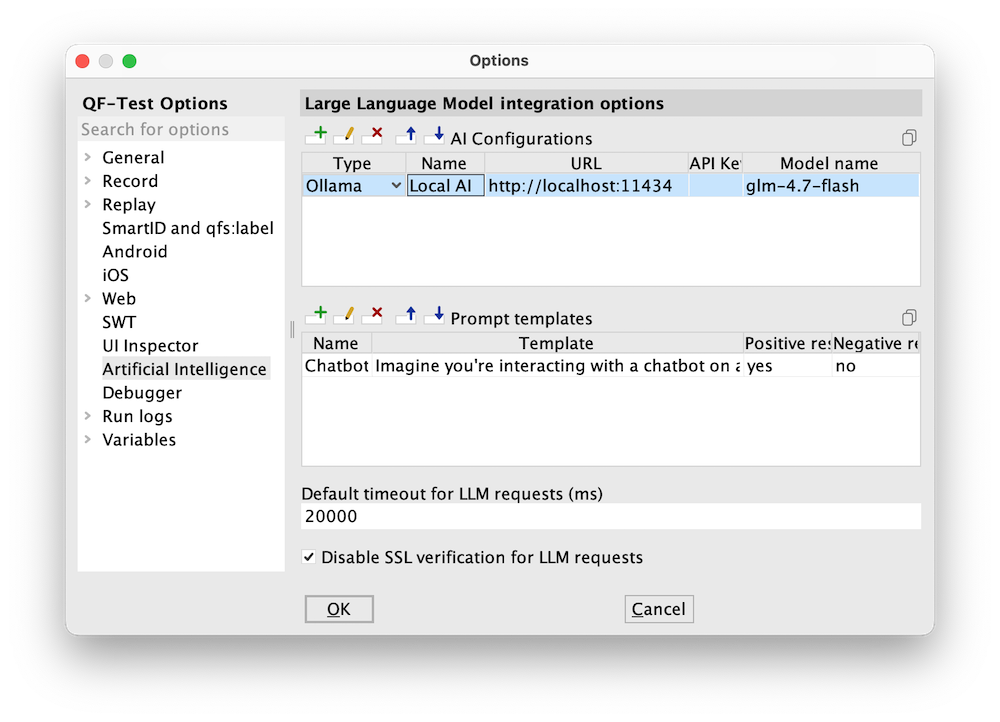

Sie können den Ollama-Server bequem über den Optionen-Dialog mit QF-Test verbinden. Dieser ist über QF-Test → Optionen → KI-Integration erreichbar. Klicken Sie auf das “Plus”-Symbol, um eine neue Zeile zur Tabelle “KI-Konfigurationen” hinzuzufügen, und geben Sie die die folgenden Daten an:

- Typ: “Ollama”

- Name: “Lokale KI” (oder ein beliebiger anderer Name)

- URL: “http://localhost:11434”

- API-Schlüssel: “” (leer lassen)

- Modellname: “llama3.2” (der Name eines Modells, das Sie über

ollama pullzu Ollama hinzugefügt haben)

QF-Test macht es ebenso einfach, ein KI-Modell über das ai-Skriptmodul zu integrieren, falls Sie lieber mit Skripten arbeiten.

Hier ist ein minimales Beispiel für ein Server-Skript, das QF-Test mit Ihrem lokal laufenden Ollama-Modell verbindet:

// Configure the AI model

ai.setDefaultConfig("Ollama", "http://localhost:11434", "", "llama3.2", displayName: "Lokale KI")

// Make a request to the AI and print it to the terminal

print(ai.ask(

"Was ist die Antwort auf die Frage nach dem Leben, dem Universum und dem ganzen Rest?",

configName: "Lokale KI"

))

Schauen wir uns an, was hier passiert:

-

ai.setDefaultConfig(...): Diese Zeile registriert das Modell mit QF-Test. Sie geben dabei Folgendes an:- Den zu verwendenden Endpunkttyp (“Provider”) (

Ollama) - Die lokale Endpunkt-URL (

http://localhost:11434) - Einen leeren String für den API-Key (für lokale Modelle nicht erforderlich)

- Den Modellnamen (

llama3.2in unserem Fall) - Einen benutzerfreundlichen Anzeigenamen (

Lokale KI) für die Verwendung in der UI

- Den zu verwendenden Endpunkttyp (“Provider”) (

-

ai.ask(...): Diese Zeile sendet einen Test-Prompt an das KI-Modell.configNamestellt sicher, dass die gerade definierte Konfiguration verwendet wird. Das Ergebnis wird direkt zurückgegeben und im QF-Test Terminal ausgegeben.

Schritt 3: KI in Ihren Tests verwenden

Über dieses einfache Beispiel hinaus können Sie Ihr lokales KI-Modell nun direkt in Ihren Testfällen einsetzen:

-

Check Text mit KI Die KI-Integration kann in einem Check Text mit KI-Knoten verwendet werden. Das ist ideal für Situationen, in denen QF-Test Text in der UI Ihrer Anwendung dynamisch validieren soll. Sie könnten zum Beispiel prüfen, ob ein Text zu einer natürlichsprachlichen Beschreibung passt oder ob er in der erwarteten Sprache verfasst ist. Weitere Informationen finden Sie in der Dokumentation hier: “Check Text mit KI”-Knoten

-

KI-Skriptmodul Für fortgeschrittene Automatisierung gibt Ihnen das Skriptmodul

aivollständige programmatische Kontrolle über KI-Anfragen in QF-Test: AI-Skriptmodul-Dokumentation

Die Vorteile eines lokalen Modells

Der Betrieb eines lokalen KI-Modells hat mehrere Vorteile:

- Datenschutz: Ihre Testdaten verlassen nie Ihre Maschine.

- Performance: Lokale Inferenz kann schneller sein als Cloud-Anfragen.

- Kostenfrei: Für Experimente ist kein API-Abonnement erforderlich.

Durch die Kombination des robusten Automatisierungs-Frameworks von QF-Test mit KI-gestützten Erkenntnissen können Sie Ihre Tests erweitern, Sprachprüfungen automatisieren oder sogar Testvorschläge generieren — und das alles, ohne Ihre Unternehmensumgebung zu verlassen.

Wie geht es weiter?

Sobald Ihr lokales Ollama-Modell läuft und in QF-Test integriert ist, können Sie zum Beispiel mit folgenden Anwendungsfällen experimentieren:

- Natürlichsprachliche Validierungen in Ihren Testfällen

- Dynamische Datengenerierung für Formulare

- Mehrsprachige Textprüfungen

Weitere Details zu allen KI-Integrationsoptionen in QF-Test finden Sie in unserem kostenlosen Spezial-Webinar “Wenn Tests mitdenken: KI-gestützte Checks mit QF-Test”:

[[qf.Preview(videos/2026-03-02-special-webinar-ai-checks)]]

Mit nur wenigen Schritten können Ihre Tests nun KI-fähig werden und gleichzeitig vollständig unter Ihrer Kontrolle bleiben. Jetzt ist der perfekte Zeitpunkt, um die Möglichkeiten der Kombination von QF-Test mit lokalen KI-Modellen zu entdecken!